Anthropic CEO Dario Amodei:AI 是「魔法」,但代价是什么

嘉宾: Dario Amodei,Anthropic CEO,前 OpenAI VP of Research 来源: Big Technology Podcast | 时长: 01:08:50 完整转录: 带说话人识别的全文转录

从父亲的病床到 AI 实验室

Dario Amodei 在旧金山长大,但和硅谷的科技创业文化毫无关系。他回忆自己的少年时代时说,科技公司的崛起在身边发生,但他完全不感兴趣——“写个网站对我来说毫无吸引力。我想当科学家,对物理和数学着迷。”

他先学物理,再转入生物学。驱动这次转向的是一个私人原因:父亲长期患病,最终于 2006 年去世。

“大约在他去世后三四年,那种病的治愈率从 50% 上升到了大约 95%。”

几年之差,生与死。Dario 说这个事实让他深刻理解了"加速"的含义。在生物学领域工作多年后,他意识到人类疾病的复杂度超出了个体研究者能处理的规模——“你需要成百上千的研究人员,而他们往往很难有效协作。“AI 是他能想到的唯一可以弥合这个差距的技术。

这段个人经历在访谈开头就被激烈地释放出来。当主持人 Alex Kantrowitz 提到 NVIDIA CEO Jensen Huang 对他的批评——“Dario 认为只有自己能安全地构建 AI,因此想控制整个行业”——Dario 的反应异常直接:“这是我听过的最无耻的谎言。”

紧接着他补充了那句让整个开场定调的话:“我父亲因为那些本可以再早几年出现的治疗方法而去世。别叫我末日论者。”

Dario 的最短时间线

在 AI 行业的主要领导者中,Dario 可能是对时间线最为激进的一个。他承认这一点,但加了一个重要的限定:“我确实是对 AI 能力快速提升最看好的人之一,但我不用 AGI 或 ASI 这些术语——这些词只是在刺激人们的多巴胺。”

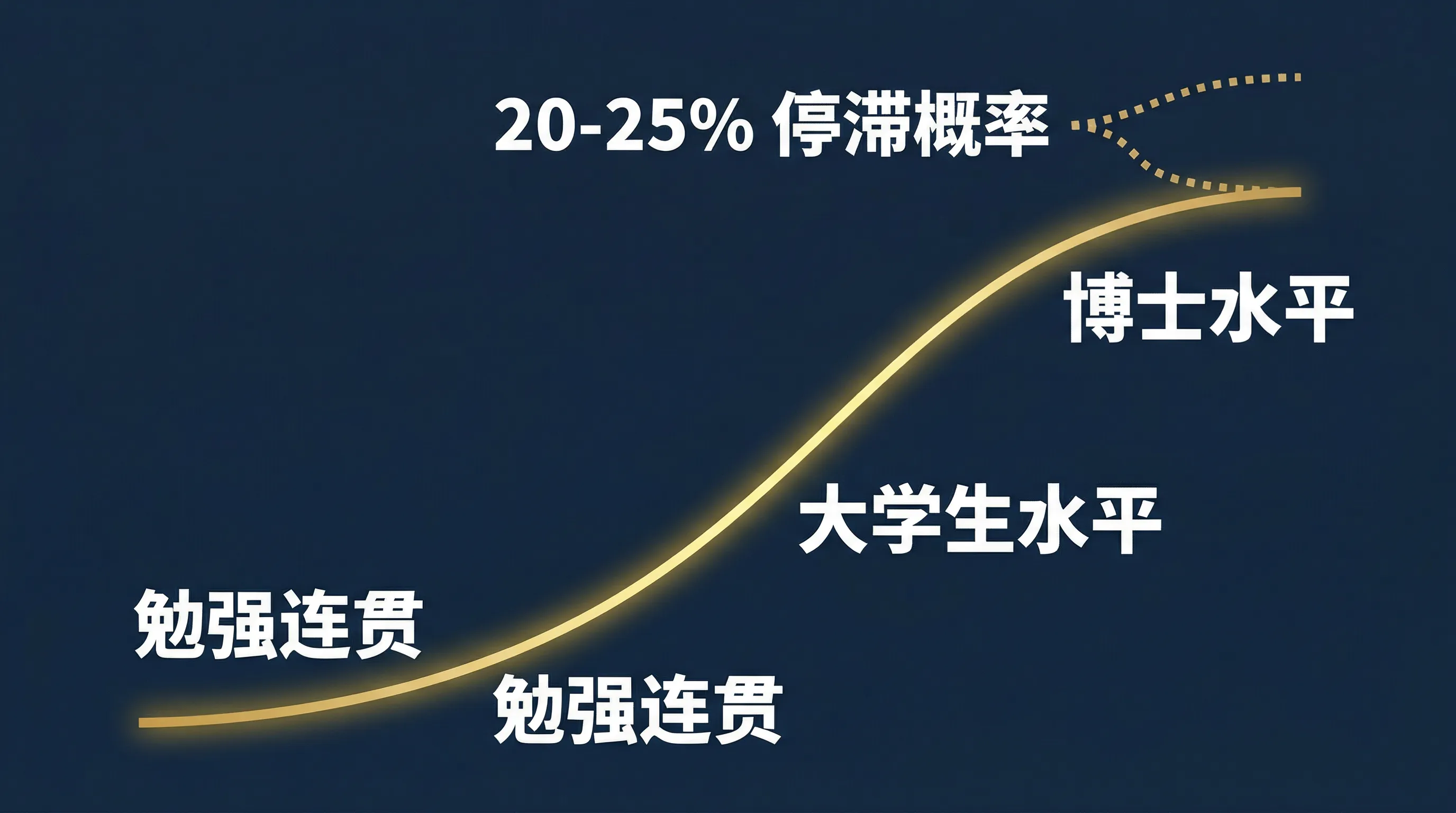

这种用词上的克制和实质上的激进形成了有趣的张力。他描述的进化曲线是:几年前 AI 模型"勉强能说出连贯的句子”,现在已经达到"聪明的大学生甚至博士水平”。

但他也保留了不确定性。当 Alex 追问具体时间线时,Dario 说:“底层技术比社会采纳更可预测,但仍然存在不确定性。我认为大概有 20% 到 25% 的概率,在未来两年内模型会因为我们不理解或者也许理解的原因而停止进步。”

“The exponential that we’re on could totally peter out.”

这句话值得注意。一位融资近 200 亿美元、全力押注 AI 持续进步的 CEO,公开承认有四分之一的概率一切可能停滞。这要么是罕见的诚实,要么是精心计算的风险对冲。更可能的是两者兼有——承认风险本身就是一种信用建设。

Scaling Laws 还在奏效吗

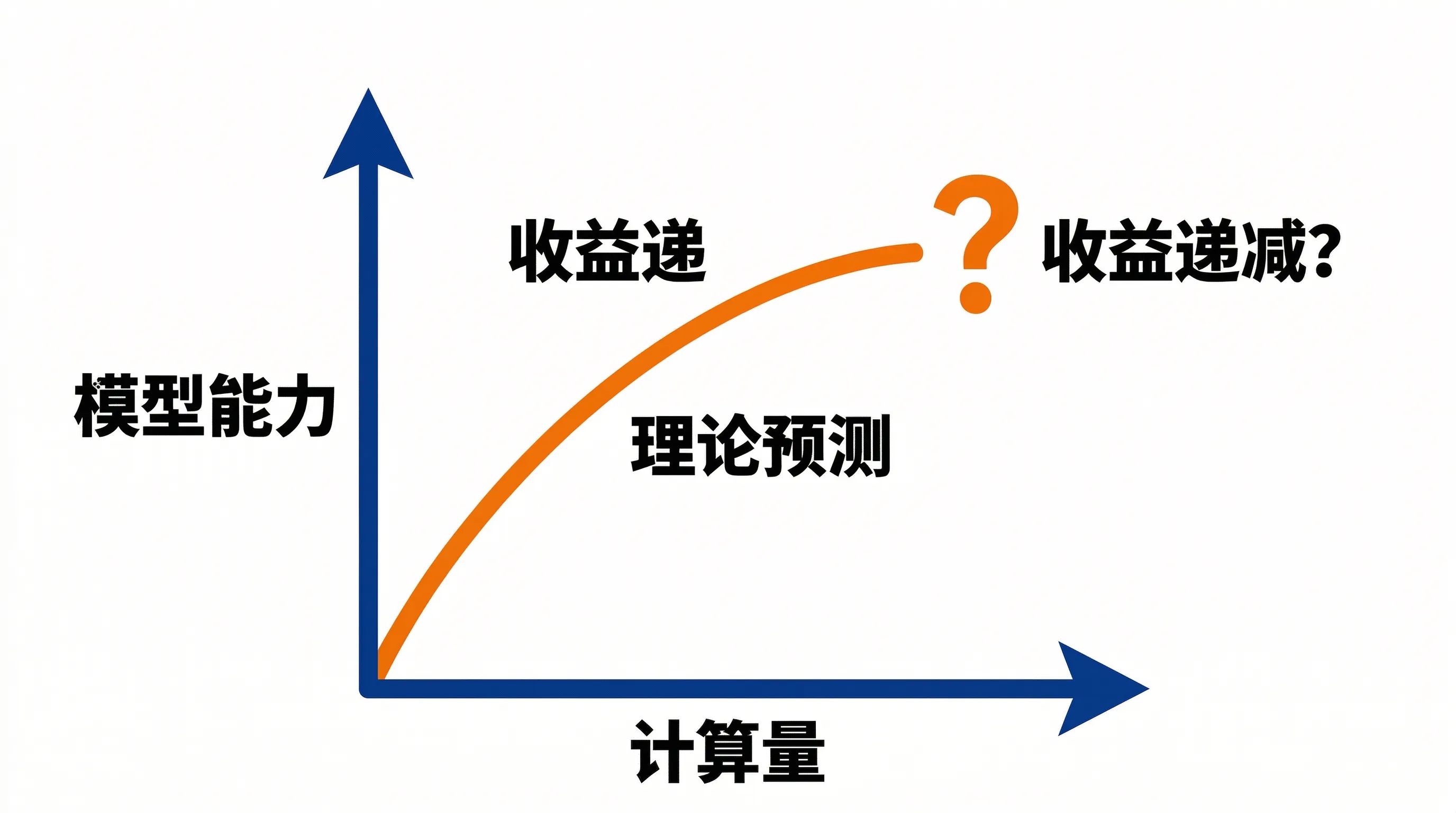

整个行业关于 scaling laws 是否遇到收益递减的争论,是这次访谈最具技术含量的部分。

所谓 scaling laws,是指一组经验规律:当你增加训练数据量、模型参数规模和计算量时,AI 模型的性能会以可预测的方式提升。2020 年前后,OpenAI(Dario 当时还在那里担任研究副总裁)发表的一系列论文将这些规律量化,发现模型性能与计算量之间存在幂律关系——这意味着只要持续加大投入,模型就会持续变好。这是 Anthropic、OpenAI 等公司大额融资的理论基础:更多钱 = 更多算力 = 更好的模型。

但到了 2025 年底,行业内开始出现不同声音。多家机构的研究人员注意到,在某些 benchmark 上,简单地增加模型规模带来的提升正在放缓。这就是 Alex 追问的背景。

Alex 直接追问:“行业里这么多人都在谈收益递减,这和你的愿景不符。他们错了吗?”

Dario 的回答聚焦于一个领域:“我只能基于 Anthropic 的模型来说。如果看 coding,coding 一直在持续改善。“这个回答很精确——他用"我只能说 Anthropic 的情况"做了范围限定,然后用最强的证据来回答。但他没有回应更广泛的领域——比如推理、数学或常识理解——是否也呈现同样的趋势。

当 Alex 引用 DeepMind CEO Demis Hassabis 的观点——“要达到人类水平的智能,可能需要几种新技术"时,Dario 简短地回应:“我们每天都在开发新技术。“但他没有具体说明是什么技术,也没有回应 Hassabis 暗含的意思——仅靠 scaling 可能不够。

他在另一个方向上展现了坦诚。Alex 提到大语言模型的一个已知局限——持续学习(continual learning)问题,即模型无法像人类一样从持续的经验中学习和更新知识。Dario 没有否认这个问题的存在,而是重新定义了它的重要性:“即使我们永远解决不了持续学习问题,LLM 在经济层面产生巨大影响的潜力仍然非常高。”

他用自己的学术背景来支撑这个观点。他曾在生物学领域工作多年,他认为即使 AI 无法像人类一样持续学习,它在处理复杂问题上的规模优势——能同时"消化"海量论文和数据——已经远超人类团队的协作能力。

这个论述的逻辑是:即使有局限性,当前技术路线已经足够有价值。这比"一切都在变好"的论述更有说服力,但也巧妙地回避了核心问题——scaling laws 到底是在加速、平缓还是拐头向下。对一个融资 200 亿押注"继续 scale"的公司来说,这个问题的答案价值连城。

200 亿美元够不够花

Anthropic 面临一个明显的结构性问题:它不是 Google、不是 Microsoft、不是 Meta。这些万亿市值的公司可以投入 1000 亿美元建数据中心而不伤筋动骨。Anthropic 即使融了近 200 亿美元,在绝对资金量上仍然处于劣势。

Alex 把这个问题摆上台面:“也许 Anthropic 是一家有正确想法但错误资源的公司。”

Dario 的回应是他全场最精炼的商业论述:

“如果我们能用 1 亿美元做到别人用 10 亿才能做到的事,用 100 亿做到别人用 1000 亿才能做到的事——那投资 Anthropic 的资本效率是其他公司的 10 倍。你是愿意拥有 10 倍的效率,还是一个大的初始资金池?”

他进一步解释,三年前 Anthropic 只融了"几亿美元”,而 OpenAI 已经从微软获得 130 亿。但 Anthropic 的增长证明了这个逻辑——“我们在这个规模上是历史上增长最快的软件公司。”

关于 Meta CEO Mark Zuckerberg 用高薪挖 AI 人才的做法,Dario 的评价颇为尖锐:“Zuckerberg 在试图购买一样买不到的东西——对使命的认同。“他补充说,Anthropic 很少有员工被挖走,“不是因为没人来挖,我和很多收到报价的同事谈过。”

他总结道:“我对他们正在做的事情相当悲观。“这可能是全场对竞争对手最直接的攻击。

为什么 Anthropic 押注企业而非消费者

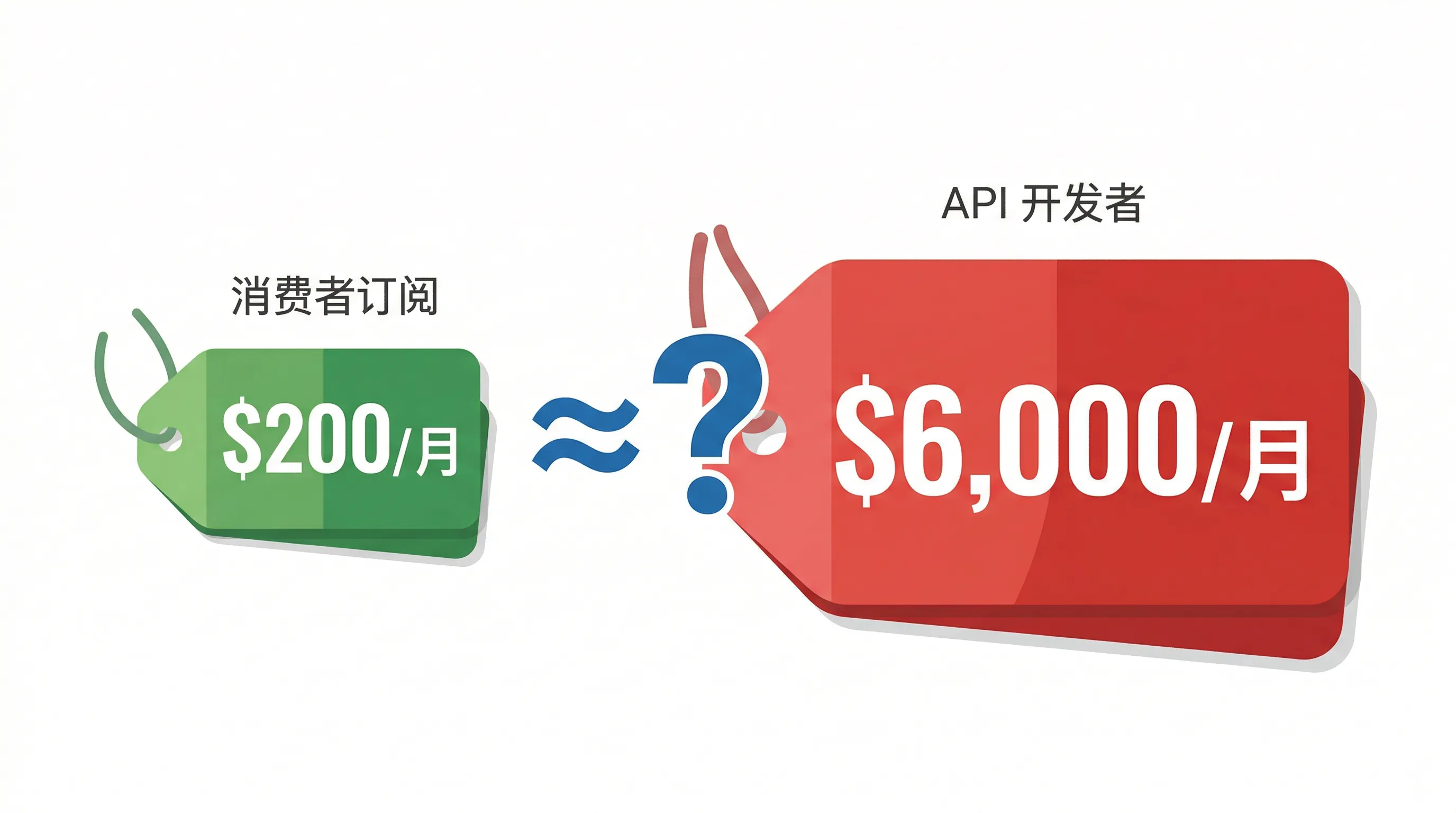

CNBC 引用内部文件报道,Anthropic 60% 到 75% 的收入来自 API。Dario 没有确认具体数字,但承认"大部分确实来自 API”,同时强调应用业务、Max 订阅和 Claude Code 也在快速增长。

更有趣的是他对这个选择的解释。OpenAI 押注消费者(ChatGPT),Google 押注现有产品整合(Gmail、Calendar),而 Anthropic 押注企业级应用。

Dario 用了一个思维实验来说明为什么:

“假设我有一个模型,它的生物化学水平从本科生提升到了博士生。如果我把这个告诉一个消费者——‘好消息,模型在生化领域从本科水平提升到了博士水平’——可能只有 1% 的消费者在意。但如果我把它卖给一家制药公司,他们的整个商业模式可能因此改变。”

这解释了 Anthropic 为什么如此看重 coding 作为核心用例。Dario 说 coding 是所有用例中"价值最突出的”,而且有一个自我强化的循环——“让模型更擅长 coding,实际上帮助你开发下一代模型。”

开发者为什么在抱怨

这是访谈中火药味最浓的商业话题之一。Alex 直指一个现象:开发者在 Cursor 等工具中使用 Anthropic 的新模型时,成本比以前明显上升了。

Dario 承认 Anthropic 的定价存在令人困惑的错位:一个消费者花 200 美元/月的订阅费,可以获得相当于 6,000 美元/月 API 调用的服务。这意味着消费者端在大幅补贴,而 API 开发者承担了更高的边际成本。

他的解释是推理优化仍处于早期阶段:“我们不断在做改进,让模型效率提升 50%。我们才刚刚开始优化推理。”

当 Alex 追问盈利时间线时——“听说今年亏损可能达到 30 亿美元”——Dario 没有给出直接回答,而是构建了一个有趣的思维框架来解释持续亏损:

“假设 2023 年你花 1 亿训练一个模型,2024 年你用 2023 年的模型赚了 2 亿收入,但花了 10 亿训练新模型。2025 年那个 10 亿的模型赚了 20 亿,但你又花了 100 亿训练下一代。每一年看起来都在亏损,但实际上每一代模型都是盈利的。”

这个框架实际上是在说:AI 公司的亏损不是传统意义上的"入不敷出”,而是一种前瞻性投资——每一代模型的收入都超过了它的训练成本,只是下一代的训练开支更大。在 Dario 的叙事里,这更接近于亚马逊早年"不分红、全部投入增长"的逻辑。

但这个论述有一个关键的循环依赖:它的前提是 scaling laws 持续有效——每一代更贵的模型确实能产生更多收入。而 Dario 自己承认有 20-25% 的概率 scaling laws 会停滞。如果模型停止进步,这个「先亏损后回收」的循环就会断裂:你花了 100 亿训练的模型不比 10 亿的好多少,但市场已经习惯了 10 亿模型的价格。

他还提到推理成本在不断下降——“推理已经从几年前到现在改善了巨大的量”。这是一个更扎实的论点。即使模型能力不再提升,推理效率的提升也能持续改善利润率。但他没有把这两个论点(模型进步 vs 推理优化)分开讨论,而是混在了一起。

「开源是个伪命题」

在所有论点中,Dario 对开源 AI 的态度可能是最容易被挑战的。

他说:“我认为开源实际上是一个伪命题(red herring)。“他的论据是:开源模型并不免费,你必须在云端运行推理,而且有人必须让推理足够快。“当我思考竞争时,我想的是哪些模型在我们做的任务上表现更好,而不是开源还是闭源。”

他还提到 Anthropic 正在提供模型微调、可解释性接口和激活引导(steering)等功能,暗示闭源模型可以提供开源做不到的附加价值。

但这个论点存在明显的漏洞。Meta 的 Llama 系列已经证明开源模型可以在许多任务上接近前沿水平,而整个开源生态——包括推理优化工具 vLLM、llama.cpp 等——正在快速降低部署成本。将开源简化为"需要人做推理”,忽略了开源模式在灵活性、可审计性和成本控制方面的系统性优势。

Dario 对开源的 dismissal 与 Anthropic 的商业模式直接相关:如果开源足够好,API 公司就失去了存在理由。值得注意的是,Anthropic 本身并没有完全拒绝"开放"的概念——他们发表了大量安全研究论文,公开了可解释性研究的方法。但在模型权重这个最核心的商业资产上,他们坚守闭源路线。

这个立场也与安全叙事相互强化:闭源可以被框定为"负责任地控制模型访问”,而不仅仅是商业保护。这种安全与商业利益的高度一致性,既是 Anthropic 叙事的力量来源,也是它最大的可信度挑战。

「竞逐顶端」还是自我营销

访谈的最后 20 分钟是张力最大的部分。Dario 阐述了他反复提及的"Race to the Top"概念:

“在 Race to the Bottom 中,所有人都在争先恐后地把东西推出去。无论谁赢,所有人都输。因为你制造了不安全的系统。Race to the Top 的逻辑是,无论谁赢,所有人都赢——因为你为行业设立了标准。”

他以 Anthropic 率先发布"负责任扩展政策”(Responsible Scaling Policy)为例,说明"设立标准"的具体含义。他认为这种自愿承诺会带动其他公司跟进,形成正向循环。

Alex 然后抛出了 SBF(Sam Bankman-Fried)的话题——这位 FTX 创始人曾试图投资 Anthropic。Dario 透露他大概见过 SBF 四五次,印象是"一个 move fast and break things 的人”,对 AI 感兴趣,也关注 AI 安全。“但回头看,那种 move fast and break things 比我想象的要极端得多、糟糕得多。“他提到最终只给了 SBF 非投票权股份——言下之意是即便在对方如日中天时,他也保持了警惕和距离。这个细节值得注意,因为它暗示了 Dario 对硅谷"快速行动"文化的不信任,而这种不信任正是 Anthropic 安全叙事的情感基础。

Alex 追问了一个关于访谈前的细节:他在采访前提到了 Jensen Huang 的批评,Dario 对此"非常激动”。在镜头前,Dario 再次强调那是"彻头彻尾的谎言”,并用"Race to the Top"来解释自己的真实意图——不是要独占行业,而是要让所有参与者都提高安全标准。

但访谈真正的高潮在最后一个问题。Alex 说:“你说 AI 是一项危险的技术,你也说自己痴迷于产生影响力。我好奇的是——你对影响力的渴望,是否在推动你加速这项你自己认为危险的技术?”

这个问题直指 Dario 公众形象中最深的矛盾:一个声称比任何人都更担忧 AI 风险的人,同时在用数百亿美元加速构建更强大的 AI 系统。

Dario 的回答很长,他列举了自己在安全领域的贡献——可解释性研究、负责任扩展政策、公开发表安全研究。他说:“我比行业中任何人都更多地警告过 AI 的危险性,而且随着模型变得更强大,我在越来越大声地发出警告。“他表示自己"担心 AI 的风险正在越来越近”。

但他没有直接回答 Alex 的核心追问——如果你真的相信风险在逼近,为什么还在加速?他的潜台词似乎是:正因为风险在逼近,才需要一个负责任的玩家(即 Anthropic)站在前沿,而不是把这个位置让给不那么注重安全的竞争对手。

这个逻辑是否成立,取决于你是否相信一家公司可以同时最大化竞争力和最大化安全——而历史上,很少有公司能做到两者兼得。

编者分析

嘉宾立场

Dario Amodei 是 Anthropic 的 CEO 和联合创始人。他的每个论点都与 Anthropic 的商业利益存在对应关系:

- Scaling laws 仍然有效 → Anthropic 需要持续大额融资来训练更大的模型

- 人才密度 > 资本规模 → Anthropic 相对于万亿市值巨头的核心叙事

- 开源是伪命题 → Anthropic 的 API 商业模式需要闭源模型保持优势

- 安全是差异化 → “Race to the Top"让 Anthropic 区别于 OpenAI 和 Meta 的"快速推进"路线

这不意味着他的论点一定是错的,但读者应意识到,这些论点的正确与否直接关系到他领导的公司价值数百亿美元的融资是否合理。

论证中的选择性

只用 coding 举证 scaling laws:当被追问收益递减时,Dario 只引用了 coding 领域的进步。他没有提及推理能力、数学、常识理解等其他领域的 benchmark 趋势,也没有回应多家研究机构报告的跨领域进步放缓。

模糊的盈利时间线:用"每一代模型都比上一代更赚钱"的框架来解释持续亏损,但没有给出具体的盈亏平衡时间点。这个框架的前提是 scaling laws 持续有效——而他自己承认有 20-25% 的概率并非如此。

对开源的简化:将开源 AI 的竞争威胁简化为"推理需要钱”,忽略了 Llama 3、Mistral 等开源模型在快速缩小与闭源前沿模型差距的事实,也忽略了企业客户可能更偏好可审计、可自定义的开源方案。

反面观点

经济学家的质疑:多位经济学家指出,“AI 将带来巨大经济变革"的预测在历史上类似论断中准确率并不高。Daron Acemoglu(MIT)等人认为 AI 对 GDP 的实际影响可能远低于行业预期。

安全研究者的担忧:部分 AI 安全研究者认为 Anthropic 的"Race to the Top"叙事本质上仍然是在参与军备竞赛,只是加了安全修辞。实际上,发布更强大的模型——即使附带安全措施——仍然在推动整体风险上升。

开源支持者的反驳:Meta AI 负责人 Yann LeCun 多次公开反对闭源 AI,认为只有开源才能真正实现 AI 安全和民主化,封闭开发反而增加了少数公司垄断的风险。

事实核查

| 声明 | 核查状态 |

|---|---|

| Anthropic 融资近 200 亿美元 | 基本准确 — 公开报道确认多轮融资总额在此范围 |

| OpenAI 从微软获得 130 亿 | 准确 — 截至采访时的公开数据一致 |

| 60-75% 收入来自 API(CNBC 报道) | 未否认 — Dario 承认"大部分来自 API”,但未确认具体比例 |

| “同等规模下历史上增长最快的软件公司” | 待查证 — 自我声明,未提供具体收入数据 |

| 父亲去世后 3-4 年,某疾病治愈率从 50% 升至 95% | 可信但未独立验证 — 与某些血液癌症的医学进展时间线吻合 |

核心要点

- Dario Amodei 是 AI 行业对能力提升最乐观的领导者之一,但他也公开承认有 20-25% 的概率模型会在两年内停止进步

- Anthropic 的核心竞争叙事是「10 倍资本效率」——用更少的钱做出更好的模型,这依赖于人才密度的持续优势

- 他认为开源 AI 是「伪命题」,企业级 API 才是 AI 商业化的主要形态——这与 Anthropic 的商业模式完全一致

- 父亲因医疗进步差几年而去世的经历,被 Dario 用来建立加速 AI 研究的道德正当性,也是他最有力的情感论据

- 「Race to the Top」框架试图将安全定位为竞争优势而非阻碍,但他未能直接回答影响力欲望与加速风险之间的张力

整理自 Anthropic CEO Dario Amodei: AI’s Potential, OpenAI Rivalry, GenAI Business, Doomerism,2026-03-02

如果这篇文章对你有帮助,欢迎请我喝杯咖啡,支持我继续创作更多内容。

Buy me a coffee