【深度访谈】Ilya Sutskever:AI 的扩展时代已经结束

嘉宾档案

Ilya Sutskever,SSI(Safe Superintelligence Inc.)创始人兼 CEO。AlexNet 联合发明人(2012),OpenAI 联合创始人兼前首席科学家(2015-2024),GPT 系列论文合著者。2024 年创立 SSI,累计融资 30 亿美元,估值 320 亿美元。

来源:Dwarkesh Podcast,2025 年 11 月 25 日发布,时长 96 分钟。

背景:这是 Ilya 离开 OpenAI 后最深度的公开对话。2023 年 11 月他参与了 OpenAI 董事会罢免 Sam Altman 的行动,2024 年 5 月正式离开并创立 SSI。2025 年 7 月联合创始人 Daniel Gross 被 Meta 挖走后,Ilya 本人接任 CEO。

这场近两小时的谈话覆盖了当下 AI 行业最核心的几个断裂点:模型评测与经济回报的脱节、扩展范式的天花板、人类学习效率之谜,以及情感在智能中扮演的角色。Ilya 的判断——“公司数量比 idea 多很多”——指向一个硅谷不愿面对的事实:当所有人都在做同一件事时,真正的创新反而停滞了。他正在重新考虑"直冲超级智能"的路线,并透露 SSI 的技术方向涉及一个他"有很多看法但环境不允许公开讨论"的根本性问题。在谈及 AI 的终极目标时,他认为超级智能应该关爱"有情众生"而非仅关爱人类——因为未来的有情存在中,人类将只占极小的一部分。

第 1 章:一个让人困惑的断裂——Eval 表现与经济影响的脱节

Ilya 开场就指出了一个反直觉的现象:当前 AI 模型的评测成绩与其经济影响之间存在严重的不匹配。

“The models seem smarter than their economic impact would imply. This is one of the very confusing things about the models right now.”

“模型看起来比它们的经济影响所暗示的要聪明得多。这是当前模型最令人困惑的事情之一。”

这种脱节体现在日常使用中。Ilya 举了一个编程辅助的例子:你告诉模型有个 bug,它修复后引入了第二个 bug;你再指出第二个 bug,它又把第一个 bug 带了回来。两个 bug 之间可以无限交替。一个在 eval 上表现惊艳的模型,怎么会犯这种错误?

他给出了两个解释。第一个他称之为"whimsical"(异想天开的):RL 训练可能让模型变得过于单一和狭隘,在获得某些能力的同时丧失了基本的全局感知。但第二个解释更具结构性意义。

预训练时代有一个巨大的优势:不需要选择数据。所有数据全部塞进去,结果自然涌现。但当行业转向 RL 训练后,选择变得不可避免——训练什么环境、优化什么目标,都需要人为决定。而在这些决定中,研究者不自觉地以 eval 为导向来设计 RL 环境。他们看着评测榜单想:我希望模型在这个任务上表现出色,那就为这个任务设计训练环境。

Ilya 用一个类比把这个问题说得更直白:一万小时学生 vs 天才学生。一个学生为了成为最好的竞赛编程选手,练习一万小时,记住所有算法模板和证明技巧;另一个学生只练了一百小时,但同样表现出色。谁在未来的职业生涯中会更成功?答案显而易见。当前的 RL 训练本质上在制造第一种学生——通过大量针对性训练达到高分,但这种能力未必能迁移到其他场景。

“The real reward hacking is the human researchers who are too focused on the evals.”

“真正的 reward hacking 是那些过度关注 eval 的人类研究者。”

学术界的证据支持这个判断。Stanford HAI 2025 AI Index 报告指出,MMLU、GSM8K 等传统基准已趋饱和,研究者被迫不断创造更难的新基准。ACL 2025 的一篇论文 “Data Laundering” 更是直接展示了 benchmark gaming 的手段——一个仅有 2 层的 BERT 模型通过知识蒸馏在 GPQA 上达到了 73.94%,接近 OpenAI o1 的 77.3%。当一个微型模型都能逼近前沿系统的 eval 分数时,这些分数还意味着什么?

这不是某个团队的问题,而是行业结构性激励的结果。当融资、估值、媒体报道都围绕着 eval 分数旋转时,整个系统都在做同一件事:让数字好看。

第 2 章:从 2020 到 2025——Scaling 吸走了所有氧气

Ilya 把过去十多年划分为两个时代。2012 到 2020 是研究时代:人们尝试各种想法,寻找有趣的结果。2020 到 2025 是扩展时代:scaling laws 和 GPT-3 让所有人意识到"应该扩展"。

他认为"Scaling"这个词本身的力量被低估了。

“From 2012 to 2020 it was the age of research. From 2020 to 2025 it was the age of scaling. But now the scale is so big… it’s back to the age of research again, just with big computers.”

“2012 到 2020 是研究时代。2020 到 2025 是扩展时代。但现在规模已经很大了……我们回到了研究时代,只是有了大电脑。”

Scaling 是一个词,但它告诉了每个人该做什么。公司尤其喜欢这个范式,因为它提供了一种低风险的资源分配方式——不需要研究者去冒险探索未知方向,只需要"获取更多数据、更多算力",就能确定地获得改进。相比之下,投资研究的风险高得多:你派出研究者去探索,他们可能什么都找不到。

预训练的伟大之处在于它是一个已知的配方:把一定量的计算、数据和一定规模的神经网络混合在一起,结果会更好,而且你知道它会更好。但数据是有限的。Ilya 说得很直接:“预训练终将耗尽数据。数据是显然有限的。然后你怎么办?”

现在算力已经很大。他追问了一个关键判断:如果把当前规模扩展 100 倍,一切会被彻底改变吗?“会有改进,但我不认为会带来质变。”

这个判断在业界远非共识。Geoffrey Hinton 认为 scaling 远未结束,AI 将自己生成训练数据突破瓶颈。Dario Amodei 表示"scaling alone will get us to AGI"。Demis Hassabis 坚持"must push scaling to the maximum",给 AGI 在 2030 年到来 50% 的概率。Sam Altman 继续投入数百亿基础设施。只有 Yann LeCun 与 Ilya 部分一致,称"general intelligence is complete BS"。

扩展时代的另一个后果是思想的同质化。Scaling 吸走了房间里所有的氧气,所有人开始做同一件事。

“We are in a world where there are more companies than ideas by quite a bit… If ideas are so cheap, how come no one’s having any ideas?”

“我们处于一个公司数量远多于创意数量的世界……如果创意那么廉价,为什么没人在产出创意?”

硅谷有句老话:ideas are cheap, execution is everything。Ilya 认为这句话有道理,但它掩盖了一个事实——当执行变成了所有人都在做的同一件事时,真正稀缺的反而是差异化的想法。他回顾历史:AlexNet 只用了 2 块 GPU,Transformer 论文没有使用超过 64 块 2017 年的 GPU(相当于今天的 2 块)。突破性研究从来不需要最大规模的算力。

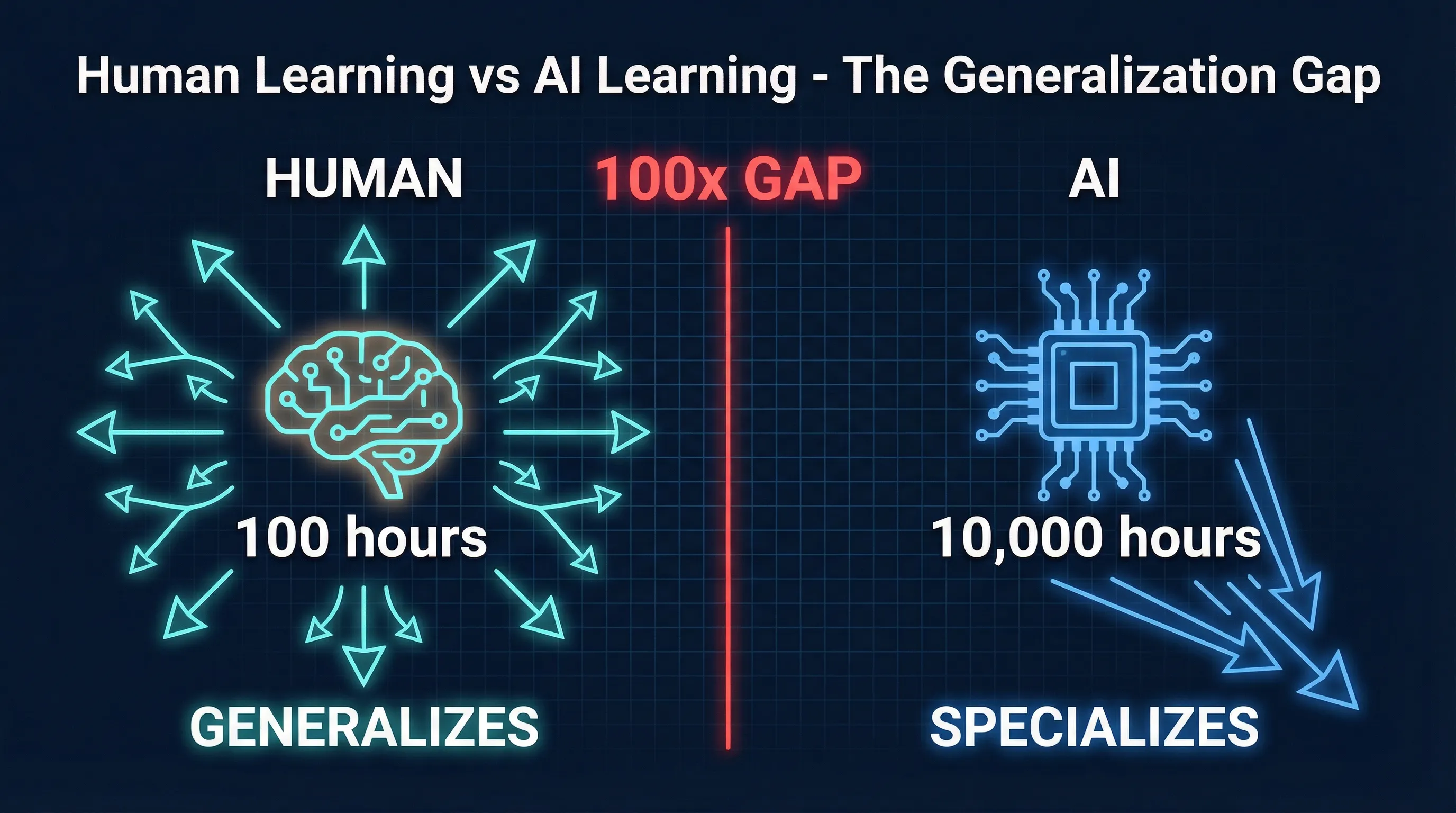

第 3 章:为什么 AI 泛化不如人类——一个根本性的缺失

在 Ilya 的分析框架中,eval 与经济影响的脱节、scaling 的天花板,最终都指向同一个根本问题:泛化。

“These models somehow just generalize dramatically worse than people. And it’s super obvious that seems like a very fundamental thing.”

“这些模型的泛化能力就是比人类差得多。这太明显了,看起来是个非常根本性的问题。”

他把泛化问题拆解为两个子问题。第一是样本效率——为什么模型需要远超人类的数据量才能学会同样的事?第二是可教导性——为什么教模型一件事比教人类困难得多?你在指导年轻研究者时,不需要设置一个可验证的奖励函数,不需要设计课程大纲,不需要担心训练不稳定。你展示你的代码、分享你的思维方式,他们就从中学会了你的研究方法。模型做不到这一点。

对于样本效率,一个自然的解释是进化。进化给了人类最少量的、最有用的信息。在视觉、听觉、运动等领域,这个解释说得通——人类灵活性远超机器人,而机器人要在仿真中经历大量训练才能接近人类水平。你可以说,这些都是人类祖先经历了数亿年进化积累的先验知识。

但 Ilya 指出一个关键的例外:数学和编程。这些是近代才出现的技能,进化对此毫无准备。然而人类在学习数学和编程时依然表现出远超模型的效率和鲁棒性。这意味着人类的学习优势不仅来自进化硬编码的先验,还来自某种更根本的学习原理。

当主持人 Dwarkesh Patel 追问这个原理具体是什么时,Ilya 给出了一个意味深长的回答:

“That is a great question to ask, and it’s a question I have a lot of opinions about. But unfortunately, circumstances make it hard to discuss.”

“这是个很好的问题,我对此有很多看法。但遗憾的是,环境不允许公开讨论。”

他补充了一个可能让问题更困难的因素:人类神经元实际做的计算可能比我们认为的更多。如果这是关键因素,那复现人类学习能力的难度会更大。但无论如何,他认为人类的存在本身就证明了这种学习原理是可实现的。

这段对话需要审慎看待。从分析角度,这是一个不可证伪的声明——他声称拥有关键洞察但不能公开,读者无法评估其真实性。这既可能是 SSI 确实掌握了独特技术方向的诚实表达,也可能是为一家零收入、纯研究公司的 320 亿估值提供叙事支撑的策略性模糊。EA Forum 分析者 Yarrow Bouchard 指出,SSI 的保密"方便地掩盖了他们可能还没有任何 OpenAI、DeepMind 没有的绝妙想法这个事实"。历史上专注基础研究的 AI 初创公司——如 Vicarious、Numenta——都未能成功将研究产品化。

但也需要承认:Ilya 是极少数亲历并推动了深度学习每一个关键节点的人。他的判断在过去十年被反复验证。当这样一个人说"存在某种未知的根本性学习原理"时,即使无法验证,也值得认真对待。

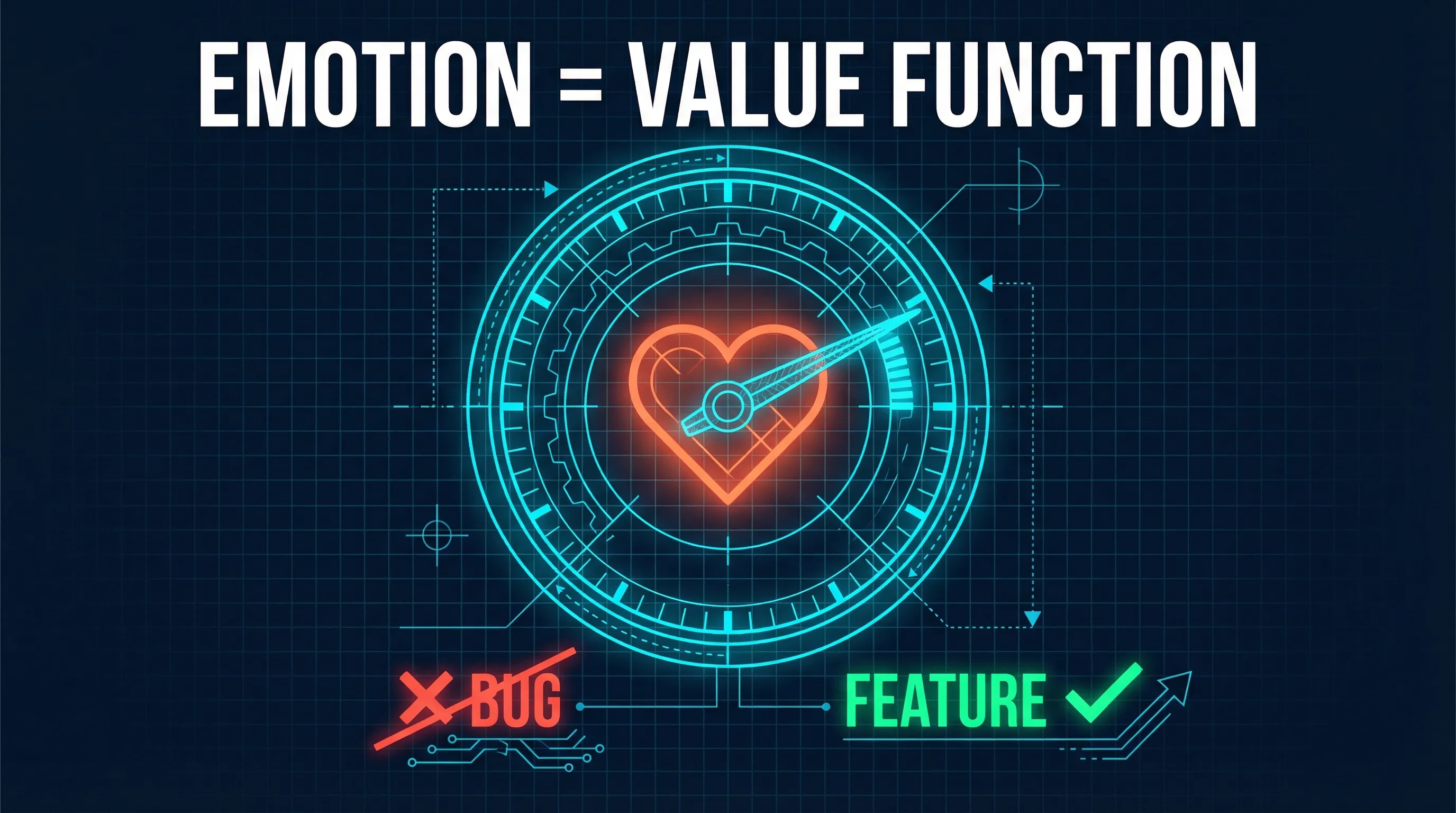

第 4 章:情感不是 Bug,是 Feature——价值函数与人类决策的秘密

在讨论人类学习效率的根源时,Ilya 引入了一个出人意料的角度:情感。

他提到一个神经科学案例。一个人因脑损伤失去了情感处理能力——不再感到悲伤、愤怒或兴奋。智力测试显示一切正常,他仍然能解谜题。但在日常生活中,他彻底崩溃了。

“He stopped feeling any emotion… and he became somehow extremely bad at making any decisions at all. It would take him hours to decide which socks to wear.”

“他不再感受到任何情感……并且变得极度无法做出任何决定。选穿哪双袜子都要花好几个小时。”

这个案例最可能对应神经科学家 Antonio Damasio 记录的患者"Elliot"——腹内侧前额叶皮层受损,智力完好但决策能力严重退化。Damasio 的躯体标记假说(Somatic Marker Hypothesis)认为,情感不是理性决策的干扰项,而是其必要组成部分。缺失了情感信号的"标记",人类即使拥有完好的推理能力,也无法在现实世界中做出有效决策。

Ilya 由此引出一个对 AI 训练至关重要的类比:当前 RL 的核心瓶颈在于只有终局奖励。模型接到一个问题,经过数千甚至数十万步推理后产出答案,然后才得到一个分数作为训练信号。在答案出来之前,整个过程没有任何学习发生。这就是 O1、R1 等系统的工作方式。

价值函数(value function)的作用是"短路"这个漫长的等待。以国际象棋为例:你丢了一个子,不需要下完整盘棋就知道出了问题。价值函数让你在过程中就能判断当前方向好不好,从而大幅加速学习。

人类天然拥有这种机制。一个青少年学开车,10 小时就能上路。不是因为他们获得了某种精心设计的可验证奖励,而是因为他们有内建的价值函数——一种即时的、直觉性的反馈系统,告诉他们"这样不太对"或"越来越有感觉了"。

更引人注目的是这套系统的鲁棒性。人类的情感价值函数在进化过程中为完全不同的环境而设计——非洲草原上的生存挑战——却在现代社会中依然大体有效。

“Whatever the human value function is, with a few exceptions around addiction, it’s actually very, very robust.”

“不管人类的价值函数是什么,除了成瘾这类例外,它实际上非常、非常鲁棒。”

Ilya 认为这种鲁棒性恰恰来自情感的简单性。复杂的系统可能在特定场景下很有用,但简单的系统在极宽泛的情境中都有用。人类的情感系统大多从哺乳动物祖先继承而来,在人类阶段只做了少量微调,加入了一些社会性情感。正因为不够复杂,它反而在一个与原始环境截然不同的现代世界中依然适用。

但这引出了一个更深的谜题。Ilya 说,理解进化如何编码低层级欲望(比如对食物气味的偏好)并不困难——气味是化学信号,进化只需让大脑追逐特定化学物质。但进化还赋予了人类复杂的高层社会欲望:我们在意他人的看法、在意社会地位、在意群体中的站位。这些不是低层级的感官信号,大脑需要整合大量信息才能理解"社交状况",然后进化说"这就是你应该在意的东西"。

他认为这些社会性欲望是近期进化的产物,说明进化在编码高层欲望方面效率极高。但具体机制是什么,他坦承自己没有满意的假说。他提出过一个猜想——也许进化通过大脑区域的"GPS 坐标"来硬编码欲望,即当某个固定位置的脑区激活时,就触发对应的欲望。但他自己也否定了这个猜想:有些人在儿童时期切除了半个大脑,所有脑区依然重新组织到了剩余的一个半球上。脑区的位置不是固定的。

这个谜对 AI 对齐(alignment)有直接意义。如果我们无法理解进化是如何在一个"不智能"的基因组中编码出需要整个大脑高层计算才能理解的欲望,那么在 AI 系统中工程化实现类似机制的难度可能远超预期。Ilya 没有给出答案,但他把问题的轮廓勾勒得足够清晰:人类情感系统的成功是对齐的一个生物学线索,而我们还远没有理解这个线索背后的原理。

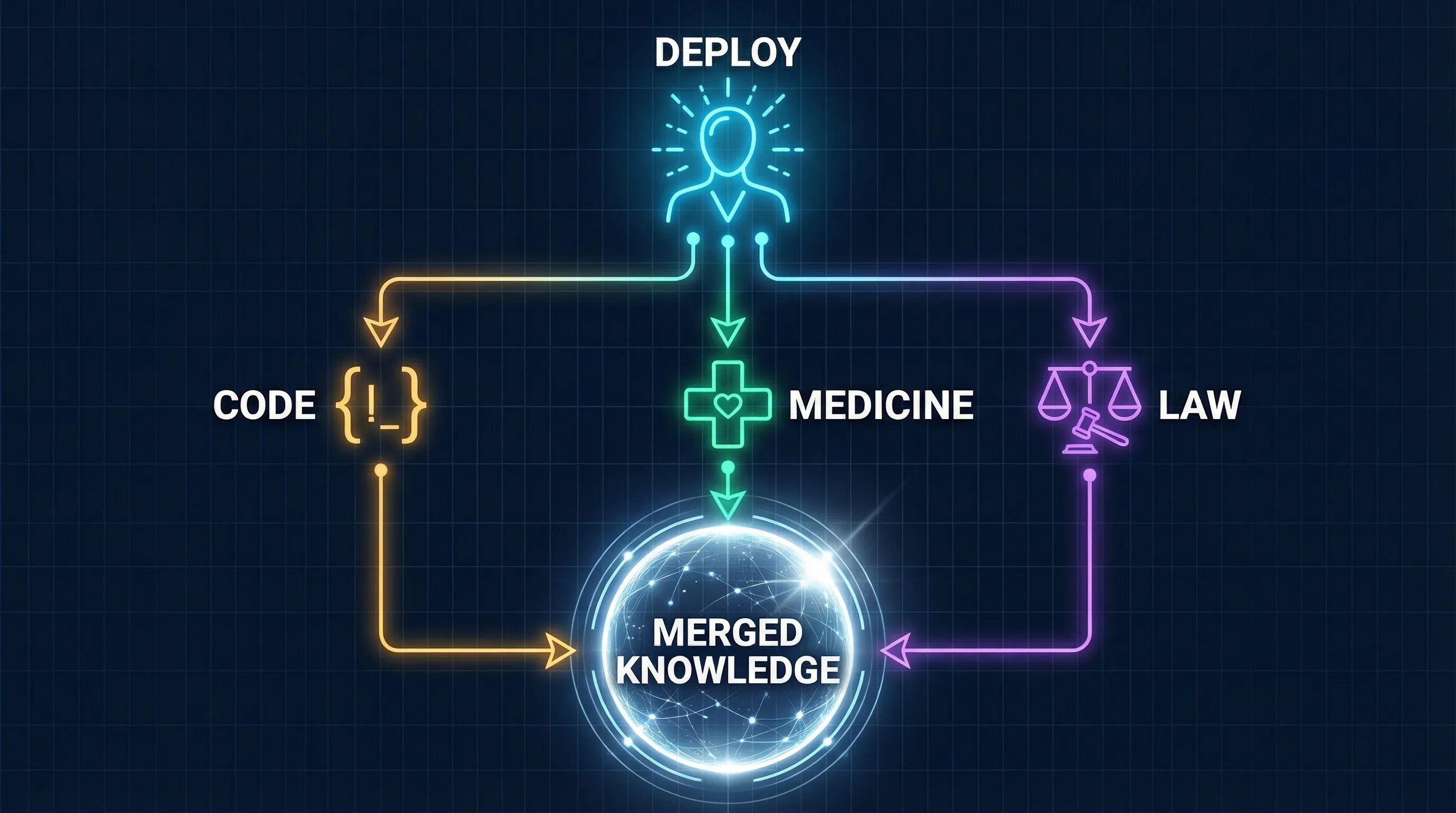

第 5 章:「人不是 AGI」——持续学习与超级智能的真实形态

Ilya 在访谈中做了一个看似简单但影响深远的语言学考古。

AGI 这个词为什么存在?它并非对智能终态的精确描述,而是一个反动产物。早期的游戏 AI、国际象棋 AI 被统一贴上了"狭义人工智能"(Narrow AI)的标签——下棋能赢卡斯帕罗夫,但做不了别的。作为回应,一部分人提出了"通用人工智能"(Artificial General Intelligence)的概念:不再狭隘,而是什么都能做。

预训练范式进一步强化了这个概念。预训练的特性恰好是:你投入更多数据和计算,模型在所有任务上都变好——“几乎均匀地”。更多预训练等于更通用,更通用就是 AGI。概念和技术路线完美咬合。

但 Ilya 认为这个叙事"过冲了目标"(overshot the target)。

“A human being is not an AGI. A human being lacks a huge amount of knowledge. Instead, we rely on continual learning.”

人类不是通用人工智能。人类缺乏大量知识,我们依赖的是持续学习。

人类的真实状态是什么?一个 15 岁的年轻人具备极强的学习能力和基础技能,但对世界几乎一无所知。他不是一个"成品",而是一个学习系统。

Ilya 用这个类比来描述他设想中的超级智能:

“I produce a super intelligent 15 year old that’s very eager to go… You go and be a programmer, you go and be a doctor, go and learn.”

我造出一个超级聪明的 15 岁少年,非常积极。你去当程序员,你去当医生,去学习。

这段话重新定义了"部署"的含义。超级智能的部署不是把一个完成品投放市场,而是一个学习过程的开始。AI 会像人类劳动者加入一个组织一样——先学习,再上手,逐步积累经验。

这带来一个更深层的推论。如果一个模型的多个实例被同时部署到经济的不同领域——一个学编程,一个学医疗,一个学法律——它们各自积累的知识可以被合并。这是人类做不到的事。人类无法"合并大脑",但 AI 可以。

Ilya 认为,即使没有递归自我改进(recursive self-improvement),仅靠这种多实例并行学习 + 知识合并的机制,你就能获得功能性的超级智能——一个掌握了经济中所有技能的单一模型。

Dwarkesh Patel 追问:这是否意味着最先实现持续学习能力的公司将赢者通吃?Ilya 的回答出人意料地乐观——他的直觉是市场竞争会天然导致专业化和生态位分化,而非垄断。多个超级智能 AI 将各自深耕不同领域,就像今天的企业占据不同市场一样。

他自己也承认:“理论上,理论和实践没有区别。但实践中是有的。“这句话可能是对自己乐观直觉的最诚实注释。

第 6 章:「权力才是全部问题」——超级智能安全的哲学

当 Dwarkesh 试图将对话引向具体的对齐方案时,Ilya 把问题拉回到一个更原始的层面。

“The whole problem of AI and AGI? The whole problem is the power. When the power is really big, what’s going to happen?”

AI 和 AGI 的全部问题是什么?全部问题就是权力。当权力足够大时,会发生什么?

他认为,任何足够强大的系统,即使目标被设定为"合理的”——比如"关爱有情众生”(care for sentient life)——如果以一种过于单一的方式极度优化这个目标,“我们可能不会喜欢结果”。这是对单一目标优化器风险的经典陈述。

Ilya 提出了一个不寻常的对齐目标:AI 应该关爱"有情众生"(sentient life),而非仅仅关爱人类。

他的论证链条是这样的:AI 本身将是有情的(sentient)。如果人类同理心的底层机制是"用模拟自身的同一套神经回路来模拟他人"——类似镜像神经元的工作方式——那么让 AI 关爱有情众生可能比让它只关爱人类更"自然",因为 AI 自己就属于这个范畴。此外,未来将有万亿甚至千万亿个 AI 存在,人类只是有情存在中的极小比例。

这段论证有一个巨大的前提:AI 是有情的。这不是一个技术判断,而是一个本体论假设——当前哲学界和认知科学界对此远未达成共识。多数认知科学家对当前 AI 系统是否具有主观体验持高度怀疑态度。Yann LeCun 认为当前 LLM 根本缺乏真正的理解,更不用说主观感受。Ilya 将 AI 有情性作为不言自明的前提来构建后续推理,但从未为这个前提本身提供论据。

Ilya 对人类也做了一个类比。他认为人类是"半 RL 代理"——追求奖励,但情感会让我们对一个目标感到厌倦,转向另一个。市场是一种短视的代理,进化同样是,政府则被设计为三个部分之间永恒的斗争。这些结构的共同特征是:没有任何一个单一目标被无限优化。

对于长期均衡,他描绘了一个不太舒服的场景:每个人都有一个 AI 代理,代替自己赚钱、参与政治、处理事务。AI 会写报告给你,你说"很好,继续"。方便,但"人不再是参与者"。这是一种体面的退场——人类在形式上仍然是主人,但实质上已经退出了决策回路。

然后他给出了一个他自己都"不喜欢"的答案:Neuralink 式的人机融合。如果人脑与 AI 直接连接,AI 理解的东西人类也同步理解——理解是"批发式传输的"(transmitted wholesale),而不是通过报告摘要。人类就不再只是旁观者,而是决策的直接参与者。

“I think it would be really materially helpful if the power of the most powerful superintelligence was somehow capped.”

如果最强大的超级智能的力量能以某种方式被限制,这将会非常有帮助。

他同时承认不知道具体如何实现这种"上限"。这整段讨论充满哲学意味,但工程细节几乎为零。他把安全问题从技术框架拉到了政治哲学和存在主义的层面——这可能是对的方向,但也可能只是因为技术层面他目前没有答案。

第 7 章:「SSI 的赌注」——30 亿美元买一张研究时代的入场券

SSI 的定位在 AI 公司中是独一无二的:零收入、零产品、纯研究。截至访谈时约 50 名员工,分布在 Palo Alto 和 Tel Aviv,累计融资约 30 亿美元,估值 320 亿美元。

“We are squarely an age of research company. We are making progress.”

我们完完全全是一家研究时代的公司。我们在取得进展。

Ilya 为 SSI 的算力劣势做了一道算术题。大型 AI 公司的巨额计算投入中,大量用于推理服务、产品功能、工程团队和销售。真正用于前沿研究实验的部分远小于标题数字。而 SSI 不做推理、不做产品,所有资源集中在研究上。“当你看实际用于研究的部分,差距小得多。”

Daniel Gross 的离开是访谈中最敏感的话题。Gross 是 SSI 的联合创始人兼前 CEO。Ilya 直接给出了事实:SSI 当时正在以 320 亿美元估值进行融资,Meta 在此时提出了收购要约。Ilya 拒绝了,Gross 则接受了——他于 2025 年 7 月加入 Meta 的 Superintelligence Labs。Ilya 补充道:“他是 SSI 中唯一一个去 Meta 的人。“随后 Ilya 本人接任 CEO。

关于是否"直冲超级智能”,Ilya 的立场正在发生微妙转变。

“There is a big benefit from AI being in the public… Having gradual access to it seems like a better way to prepare.”

AI 公开面世有很大好处……渐进式接触似乎是更好的准备方式。

他用了两个类比来支撑这个判断:飞机安全和 Linux 的稳定性——两者都不是通过纯理论推演变得安全的,而是通过部署、发现问题、修复问题的循环。他认为 AI 安全也会遵循同样的路径。

但他给出了两个转变立场的理由:一是"如果时间线很长”——这是商业现实,SSI 不可能永远不产生收入;二是"展示 AI 才能让世界准备好"——这是认知论证。他说人们难以想象未来的 AI 有多强大——“就像年轻时讨论衰老”——只有真正看到强大 AI 的表现,社会才能做出恰当的制度回应。

这两个理由混合在一起,使得这次"思想转变"既可能是理性反思,也可能是融资压力下的战略调整。将商业压力下的战略调整包装为哲学洞察,这种叙事重构值得注意。

Ilya 还做出了一个预测:当 AI 变得真正强大时,前沿公司之间将开始在安全领域合作。他表示,三年前他就预测过这件事,而 OpenAI 与 Anthropic 在安全领域的初步合作已经开始验证这个判断。他认为,不仅公司会变得"更加偏执于安全",政府和公众也会产生干预的意愿。

对 SSI 持怀疑态度的声音并不少。EA Forum 的分析者 Yarrow Bouchard 指出:SSI 的保密"同样方便地掩盖了他们可能还没有任何其他公司没有的绝妙想法这个事实"。历史上专注于基础研究的 AI 初创公司——如 Vicarious 和 Numenta——都未能成功将研究产品化。Zvi Mowshowitz 则直言,一家没有产品和收入的公司长期保持保密,“看起来可能有点可疑”。

第 8 章:「美、简洁、来自大脑的正确启发」——什么是研究品味

访谈的最后几分钟,Dwarkesh 问了一个几乎不可能回答的问题:

“What is research taste?”

Ilya 被广泛认为是 AI 领域"研究品味"最好的人之一——从 AlexNet 到 GPT-3,他参与了深度学习史上多个关键时刻。他的回答没有给出方法论,而是给出了一种美学宣言。

“Beauty, simplicity, ugliness. There’s no room for ugliness. It’s just beauty, simplicity, elegance. Correct inspiration from the brain. And all of those things need to be present at the same time.”

美、简洁、丑陋。没有丑陋的空间。只有美、简洁、优雅。来自大脑的正确启发。所有这些需要同时存在。

他用人工神经元举例:大脑有褶皱,有各种器官,但这些"可能不重要"。重要的是神经元,因为"它们数量很多,感觉是对的"。然后你需要某种局部学习规则来改变神经元之间的连接——“大脑很可能就是这样做的”。从大脑到人工神经网络的灵感转化,不是逐字翻译,而是一种审美判断——什么是本质的,什么是噪声。

他进一步展开了这种思维方式的具体表现:大脑对经验做出反应,神经网络也应该从经验中学习;分布式表征(distributed representation)的想法也来自对大脑工作方式的正确抽象。关键不是模仿大脑的所有细节,而是从多个角度思考,判断什么是"基本的",什么不是。

然后他说了可能是整个访谈中最私密的话:

“The top down belief is the thing that sustains you when the experiments contradict you. Because if you just trust the data all the time, well, sometimes you can be doing a correct thing. But there’s a bug.”

自上而下的信念是在实验与你矛盾时支撑你的东西。因为如果你总是相信数据,有时候你可能在做正确的事——只是有个 Bug。

这段话揭示了基础研究中最核心的心理过程:当实验结果告诉你"这条路不通"时,你怎么判断是方向错了,还是只是实现上有 Bug?没有公式可以回答这个问题。Ilya 的答案是多维度的美感信念——如果一个想法在多个角度上都"感觉对"——简洁、优雅、与大脑的工作方式一致——那就值得在实验矛盾时继续坚持。

这不是科学方法论,而是一种研究者的信仰结构。

Dwarkesh 问的问题是"你怎么判断该继续调试还是该换方向"。在工业界,这个问题有标准答案:设定 deadline,跑 A/B test,看指标。但在基础研究中,没有 A/B test,没有指标,有的只是一个想法和一堆矛盾的实验数据。Ilya 的回答是:如果你对这个想法的信念足够"多维度"——不仅仅是"感觉对",而是从美学、简洁性、与大脑的一致性等多个独立维度都指向同一个方向——那就值得坚持。

这解释了为什么突破性的研究不能被流水线化生产——因为最关键的判断依赖的不是数据,而是审美。这也解释了为什么"一百万个 Ilya 的复制品"不一定能加速研究——Ilya 自己也说,“你需要的是想法不同的人,而不是相同的人”。

编者分析

嘉宾立场

Ilya Sutskever 是 SSI 创始人兼 CEO,此前是 OpenAI 联合创始人兼首席科学家(2015-2024),参与了 2023 年 11 月试图罢免 Sam Altman 的董事会行动。他的"回归研究时代"叙事直接服务于 SSI 的商业定位:SSI 的算力远不如 OpenAI、Google 和 Meta,但如果竞争的核心从算力转向研究洞察力,SSI 就成了强者。“做研究不需要最大算力"不仅是分析,也是融资叙事。他对 OpenAI 式 RL 训练的批评——“人类版 reward hacking”——可能夹杂对前东家的复杂情感。

论证中的选择性

Scaling vs Research 的二分法过于干净。Ilya 将 2012-2020 定义为"研究时代”,2020-2025 定义为"扩展时代",但实际上两者始终并行。Transformer(2017)、MoE 架构、注意力机制的改进——这些关键突破都发生在所谓的"扩展时代"。将两者对立可能误导读者认为算力投资不再重要。

竞赛编程类比存在幸存者偏差。Ilya 用"练了一万小时的学生 vs 只练一百小时的天才"来论证过度训练无法泛化。但现实中大量竞赛编程出身的工程师在工业界表现优异——“一万小时"的训练并非毫无迁移价值。

**“有想法但不能说”**是一个不可证伪的声明。如果 SSI 成功,这被视为验证;如果失败,可以归因于执行问题而非方向错误。

**人类情感"极其鲁棒”**的说法忽略了认知偏见、群体极化等系统性决策错误。情感系统在个体层面提供了有效的决策启发,但在群体和制度层面常常导致灾难。

反面观点

- Geoffrey Hinton(2024 年诺贝尔物理学奖得主):AI 将自己生成训练数据,突破数据瓶颈,scaling 远未结束。

- Dario Amodei(Anthropic CEO):scaling alone will get us to AGI,仅需小幅修改。

- Yann LeCun(Meta 首席 AI 科学家):与 Ilya 部分一致,但更激进——称"general intelligence is complete BS",认为当前 LLM 根本缺乏真正的理解。

- Zvi Mowshowitz(AI 评论者):Ilya 的对齐策略"remarkably shallow"——本质上是"没有计划的计划"(muddling through)。如果超级智能只关心"有情众生"而不特别关心人类,人类没有理由期望能保持控制权。

- EA Forum 分析:SSI 的保密可能掩盖缺乏突破性发现,历史上纯研究型 AI 初创公司(Vicarious、Numenta)均未能成功产品化。

事实核查

| 陈述 | 结果 |

|---|---|

| SSI 融资约 30 亿美元 | 准确(Crunchbase/Tracxn 数据一致:10 亿 + 20 亿,估值 320 亿) |

| Daniel Gross 因 Meta 收购要约离开 SSI | 准确(CNBC/Reuters 2025 年 6-7 月报道确认) |

| Eval 与实际表现脱节 | 准确(Stanford HAI 2025 报告、ACL 2025 “Data Laundering” 论文支持) |

| 情感缺失导致决策瘫痪 | 准确(Antonio Damasio 躯体标记假说,患者 Elliot 案例) |

| “从扩展时代到研究时代” | 部分准确(多数行业领袖仍以 scaling 为核心路径) |

| 超级智能 5-25 年内到来 | 范围过宽(5 倍跨度),信息价值有限 |

核心观点

1. Scaling 的收益正在递减,但赌注还在桌上。 Ilya 判断"研究时代回归"有数据支撑——基准饱和、数据枯竭、RL 泛化不足。但 Hinton、Amodei、Hassabis 的反面论据同样有力。科技巨头 2025 年投入超过 3000 亿美元基础设施建设——他们在用真金白银表达不同意见。

2. 泛化是真正的硬问题。 无论 scaling 是否到头,Ilya 对泛化问题的分析切中了 AI 发展的核心矛盾:模型在 eval 上趋于完美,但在现实世界中仍然脆弱。他用"价值函数"和"情感"来类比解决方案——方向可能正确,细节完全未知。

3. 超级智能的问题不是技术问题,是权力问题。 这可能是 Ilya 最深刻的洞察。所有关于 AI 安全的讨论最终都指向同一个问题:当一个实体的能力足够大时,它的目标函数无论多"正确"都可能产生不可预见的后果。他的解决方案——关爱有情众生、限制功率上限、Neuralink 式融合——充满哲学意味但缺乏工程细节。

本文整理自 Ilya Sutskever – We’re moving from the age of scaling to the age of research,Dwarkesh Podcast,2025 年 11 月 25 日

Ilya Sutskever 的观点代表其个人及 SSI 的立场。文中事实核查基于公开资料,编者分析部分旨在提供平衡视角。

如果这篇文章对你有帮助,欢迎请我喝杯咖啡,支持我继续创作更多内容。

Buy me a coffee