xAI MacroHard:Elon Musk 的「人类模拟器」到底在做什么?

为什么要调查这个?

事情起因很简单:我在看 Elon Musk 最新的 Dwarkesh Patel 采访(2026年2月5日,近3小时)时,注意到一段耐人寻味的对话。

主持人反复追问 xAI 的取胜战略,Elon 显然不想在播客上透露太多,但他给出了一个极其明确的线索:

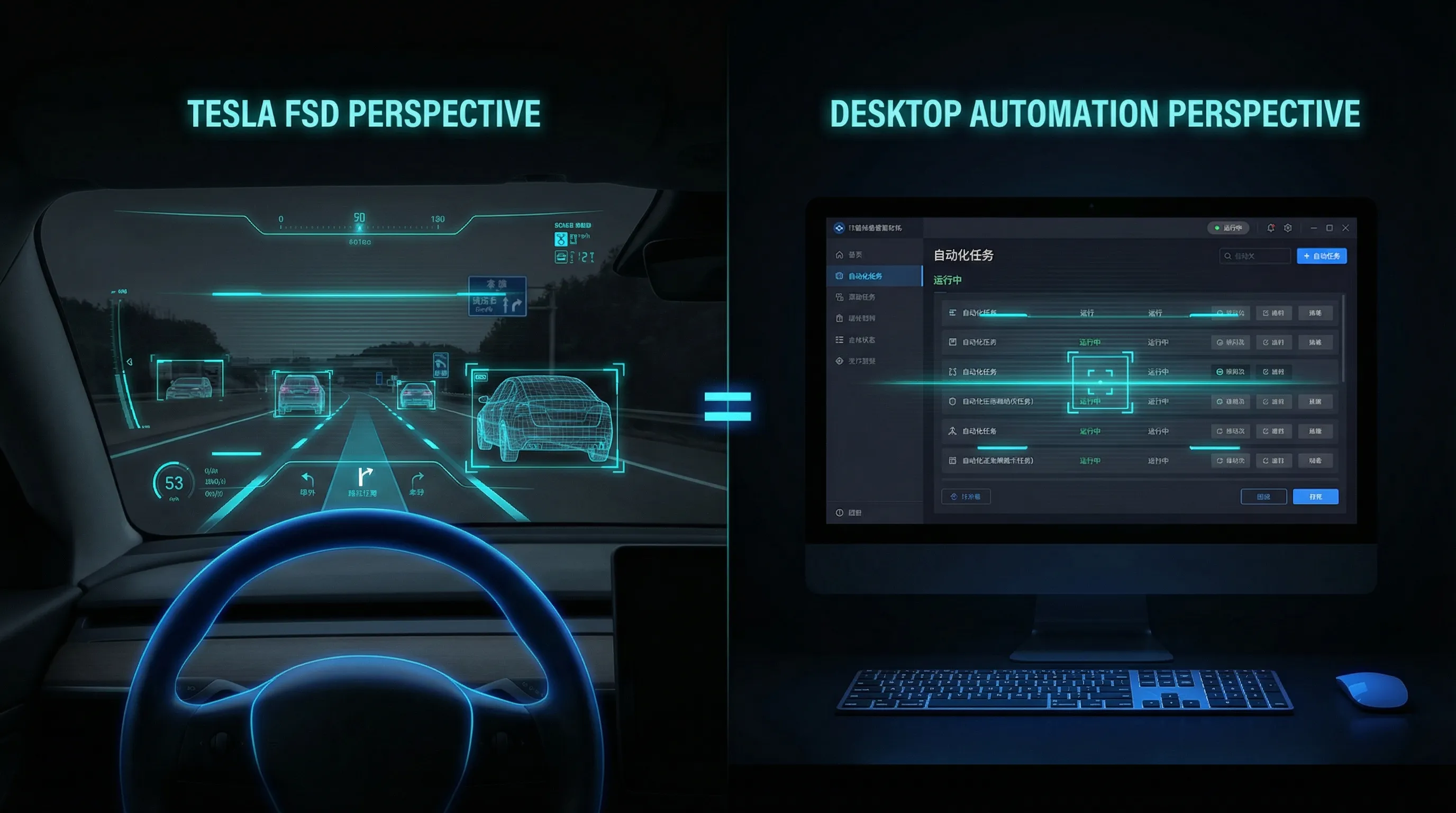

“I think I know the path to do this because it’s kind of the same path that Tesla used to create self-driving. Instead of driving a car, it’s driving a computer screen. It’s a self-driving computer, essentially.”

然后他话锋一转,主动切到广告。

这让我非常好奇——“自动驾驶电脑"到底是什么意思?恰好,前不久一位 xAI 工程师 Sulaiman Ghori 因为在播客上透露了太多内部信息而被开除(或"主动离职”),他详细描述了一个叫 MacroHard 的内部项目。

于是我做了一次系统性的调研,把两个播客的内容交叉比对,再结合 Reddit、Twitter 和技术博客上的讨论,试图还原 xAI 真正在做什么。

MacroHard 是什么?

MacroHard(取 Microsoft 微软的反义——“宏硬”)是 xAI 内部代号项目。核心目标:构建人类模拟器(Human Emulator)。

简单说:AI 看屏幕,理解内容,然后操作键盘鼠标——完全模拟人类使用电脑的方式。不需要目标软件做任何 API 适配,直接像一个真人员工一样操作现有软件。

如果说 Tesla 的 Optimus 机器人是在物理世界模拟人类,MacroHard 就是在数字世界做同样的事。

Elon 暗示了什么?Sully 泄露了什么?

这是最有意思的部分。Elon 在采访中刻意隐藏的信息,Sully 几乎全说了出来:

| 主题 | Elon 的说法 | Sully 的泄露 |

|---|---|---|

| 方法论 | “和 Tesla 自动驾驶的路线一样” | 多个全新架构在并行开发,至少一个不基于现有体系 |

| 速度 | 没提 | 1.5x 到 8x+ 人类操作速度 |

| 部署方式 | 没提 | 计划用北美 400 万辆 Tesla 的闲置 HW4 芯片做分布式推理 |

| 内部测试 | 没提 | 虚拟员工已在 xAI 内部运行,同事以为是真人 |

| 迭代速度 | 没提 | 模型每天甚至一天多次从预训练开始迭代 |

| 目标规模 | 暗示"上千到上万" | 从 1,000 到 1,000,000 个虚拟员工 |

难怪 Sully 采访发布几天后就"不再在 xAI 工作了"。

技术架构:自动驾驶电脑

MacroHard 的核心架构与 Tesla FSD 高度同构:

| Tesla FSD | MacroHard |

|---|---|

| 摄像头看路 | 截屏看屏幕 |

| 理解路况 | 理解 UI 和工作流 |

| 操控方向盘 | 操控键盘鼠标 |

| 人类驾驶数据训练 | 人类屏幕操作数据训练 |

| 车队 OTA 更新 | 每日多次模型更新 |

最反直觉的设计决策是:xAI 选择了小模型 + 极快推理,而不是其他实验室的大模型 + 长推理链路线。结果是模型速度达到人类的 8 倍,一个虚拟员工可以抵 8 个人。

更激进的是部署方案——利用 Tesla 车辆网络。北美约 400 万辆 Tesla,约一半有 HW4 芯片,70-80% 时间在闲置充电。xAI 计划向车主付费租用闲置算力,直接在车上跑 Human Emulator。不需要建数据中心,纯软件部署。

社区怎么看?

社区反响两极分化,大致是:40% 支持、30% 质疑、30% 观望。

支持者认为这是 AI 领域的"最后一块拼图"——当 AI 能像人一样操作电脑时,几乎所有数字工作都可以被自动化。

质疑者指出:FSD 面对的是相对规范的道路场景,而屏幕操作的 UI 多样性远超驾驶。一位评论者写道:“你发明了世界上最贵的实习生,附带一张 GPU 账单。”

务实派则注意到:Anthropic 的 Computer Use 和 OpenAI 的 Operator 已经在做类似的事,MacroHard 的差异化不在方法论,而在执行规模和速度。

个人能复现吗?

这是我最关心的问题。答案是:核心交互模式可以,规模效应不行。

可以复现的部分

用 Browser Use(开源,50k+ GitHub stars)+ Claude Sonnet API,$5-20/月就能跑起一个基本的浏览器自动化 Agent。它能搜索、填表、提取数据、多标签操作——覆盖大部分日常浏览器工作流。

如果需要全桌面控制,Anthropic Computer Use API 提供了完整的截屏→理解→键鼠方案,$20-50/月。

无法复现的部分

- 数据飞轮:xAI 有海量人类操作数据 → 更好模型 → 更多部署 → 更多数据。这个循环个人无法启动。

- 8x 速度:API 调用延迟 + 推理 = 每步 2-5 秒,距离 8x 人类速度差距巨大。

- Novel Architectures:xAI 正在开发可能不是 Transformer 的全新架构,这需要他们级别的算力来实验。

- 百万级并发:这是基础设施问题,不是个人能解决的。

最佳切入点

Browser Use + Claude Sonnet,专注你最重复的 3 个工作流。 大部分知识工作发生在浏览器中,先做窄做深比做宽做浅有用 100 倍。这就是个人版的 MacroHard。

结论

MacroHard 不是科幻,也不是 PPT。虚拟员工已经在 xAI 内部跑着了。

它的真正壁垒不是技术方法论(截图→理解→操作,Anthropic 已经做到了),而是三层叠加的飞轮:海量数据、极端迭代速度、Tesla 车队算力网络。

但对于个人开发者来说,好消息是:核心方法论已经被开源社区复现,$5-20/月就能开始。不需要等 xAI 把产品卖给你——你现在就可以动手。

本文基于对 Elon Musk 采访(Dwarkesh Patel Podcast, 2026.2.5)、Sulaiman Ghori 采访(Relentless Podcast)、Reddit/Twitter 社区讨论以及多篇技术分析文章的综合调研撰写。

如果这篇文章对你有帮助,欢迎请我喝杯咖啡,支持我继续创作更多内容。

Buy me a coffee